Olá pessoal! Estamos voltando com mais uma coluna Ideias em Jogo, e vamos falar de …

Ah, IA novamente? Na verdade, é que ainda percebo muitos conhecidos que desconhecem ou estão ainda naquela de “temer”. A grande verdade é que estamos passando por uma grande revolução e queira ou não temos que entender. Para isso, tomei a liberdade de pesquisar vários termos (reparem os termos em destaque no texto) que são aplicados atualmente e criar este texto com a intenção de esclarecer

Se pararmos para observar a velocidade vertiginosa das transformações tecnológicas que tomaram os noticiários e os fóruns de desenvolvimento nos últimos anos, é muito fácil sentir que fomos subitamente transportados para dentro de um filme de ficção científica cyberpunk. No entanto, como pesquisadores, desenvolvedores e entusiastas da tecnologia sabem muito bem, na ciência da computação nada surge do vácuo.

A Inteligência Artificial Generativa, ainda está em enorme evidência, mas esta é uma parte do que temos hoje em nossos computadores e motores de jogo, e isso não é tão novo assim. O termo “Inteligência Artificial” nasceu na famosa Conferência de Dartmouth em 1956. Ou seja, se a IA fosse uma pessoa, ela já seria um senhor com mais de 70 anos, com muita história para contar, carregando consigo as memórias do Teste de Turing, dos primeiros algoritmos de xadrez e dos invernos da IA, quando o financiamento secou por falta de poder computacional.

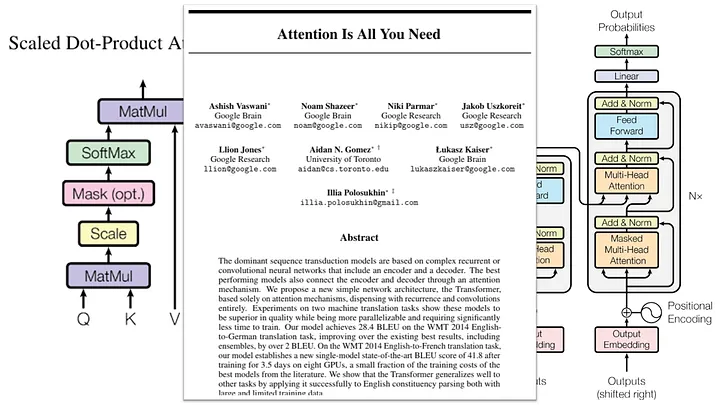

Mas se a nossa tecnologia é uma veterana, por que o momento atual parece um estrondo sem precedentes? O divisor de águas que nos trouxe ao estado da arte contemporâneo tem data e nome: o ano de 2017 e a publicação do artigo “Attention Is All You Need”, de Vaswani et al.

Este é, indiscutivelmente, um dos marcos mais importantes da inteligência artificial moderna. O artigo introduziu a arquitetura Transformer, que abandonou as antigas redes recorrentes (RNNs) e convolucionais (CNNs) em favor de um mecanismo baseado inteiramente em Atenção. Em termos práticos, isso permitiu que as máquinas analisassem o contexto de uma frase inteira de uma só vez, paralelizando o processamento e mudando para sempre a nossa relação com a máquina.

Um pouco de história

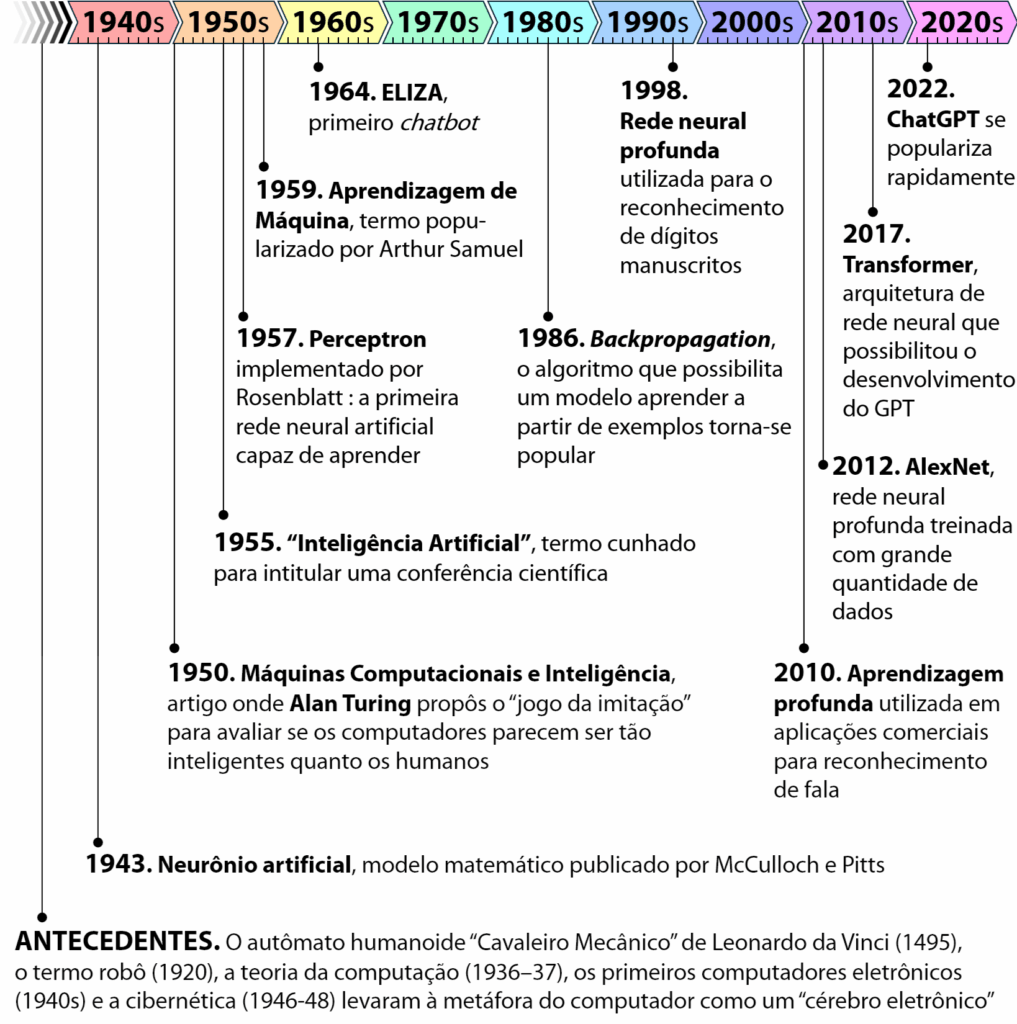

Mas vamos olhar alguns anos atrás, pois para entendermos o que estamos vivenciando hoje nos estúdios e fóruns de desenvolvimento, precisamos revisitar nossas origens de forma crítica. O uso da linguagem e a capacidade criativa sempre foram vistos como o ápice do “espírito humano”, características exclusivas da nossa espécie. Contudo, a história da computação provou que essas habilidades também podem ser simuladas por máquinas. Como observamos na linha do tempo, o marco zero dessa jornada de abstração ocorreu em 1943, com o seminal artigo de McCulloch e Pitts. Eles propuseram o primeiro modelo matemático de um neurônio artificial, a semente que serviu de base estrutural para todas as redes neurais modernas. A partir dessa faísca, a evolução conceitual engrenou: do visionário “jogo da imitação” de Alan Turing em 1950 (que fundamenta até hoje nossos testes de naturalidade para NPCs), passando pela cunhagem oficial do termo “Inteligência Artificial” em 1955, até as experimentações com o ELIZA, o primeiríssimo chatbot, em 1964. Assim como, no passado, a capacidade humana de calcular foi automatizada de forma revolucionária pelos primeiros computadores, começávamos ali a sonhar com a automação da própria comunicação.

O salto definitivo para a atual era da IA Generativa, contudo, exigiu décadas de amadurecimento em algoritmos — como a vital consolidação da técnica de backpropagation em 1986 — e um salto abissal em poder computacional de hardware. O ponto de virada definitivo ocorreu em 2017 com a introdução da arquitetura Transformer, que pavimentou o caminho para o treinamento dos gigantescos LLMs (Modelos de Linguagem de Grande Escala). Hoje, utilizando apenas um volume massivo de dados de treino e operações matemáticas avançadas, essas redes neurais processam o prompt do usuário para gerar respostas multimodais de forma quase instantânea. Elas geram textos mais rápido do que conseguimos ler, resolvem scripts complexos nas nossas engines, compõem trilhas sonoras e criam artes impressionantes em segundos. O que testemunhamos a partir da explosão popular destas ferramentas em 2022 não é magia; é a consolidação histórica de processos não humanos produzindo de forma sintética aquilo que antes acreditávamos ser uma criação intocável do nosso espírito criativo.

A Matemática da Linguagem: LLMs, Tokens e a Geração de Conteúdo

Diferente das IAs tradicionais que focavam em classificar dados (como dizer se uma imagem era de um gato ou de um cachorro), a IA Generativa é a tecnologia que gera (por isso generativa) novos dados — sejam eles blocos de texto, artes conceituais para o seu Game Design Document (GDD) ou scripts completos em C# para a Unity.

No centro desse motor criativo estão os LLMs (Large Language Models), como o Gemini ou o GPT. Esses gigantescos modelos estatísticos são treinados em volumes massivos de texto extraídos da internet. Quando você interage com um LLM, ele não “lê” palavras da mesma forma que nós. Ele processa Tokens, que são as unidades básicas (pedaços de palavras, sílabas ou caracteres) compreendidas pelo modelo. Ao analisar o contexto de milhões de tokens, a IA calcula a probabilidade da próxima sequência lógica.

É devido a essa escala incomensurável que começamos a testemunhar o comportamento emergente: capacidades imprevistas que surgem da interação de partes de um sistema complexo. Ninguém programou os LLMs explicitamente para traduzir código de Python para C++ ou para entender o sarcasmo em um diálogo de RPG, mas eles aprenderam a fazê-lo.

Contudo, essa base probabilística traz consigo um grande desafio acadêmico e técnico: a Alucinação. Como o modelo foi desenhado para sempre gerar a resposta mais provável e fluida, quando ele não sabe uma informação, ele “inventa” dados de forma incrivelmente convincente. Para domar esse comportamento, a comunidade técnica desenvolveu o Prompt Engineering, a técnica minuciosa de desenhar instruções, definir papéis e estabelecer limites para obter resultados precisos e úteis da IA.

Além do Texto: Ciência de Dados, Multimodalidade e Adaptação

Para que esses modelos saiam do senso comum e entendam contextos ultra específicos — como a documentação técnica de uma engine proprietária de um estúdio —, utilizamos o fine-tuning. Esse é o processo de ajuste fino de um modelo pré-treinado em um conjunto de dados específico. Em vez de criar uma IA do zero, você pega um modelo “educado” e ensina a ele as regras do seu universo.

Isso nos leva às raízes da ciência de dados. Ao treinar ou ajustar modelos, os engenheiros lidam constantemente com hiperparâmetros, que são as configurações externas (como a taxa de aprendizado) que controlam o processo de aprendizagem da máquina. Um dos maiores medos de qualquer pesquisador nessa fase é o overfitting: o fenômeno indesejado em que o modelo “decora” os dados de treino (memorizando um nível de um jogo, por exemplo), mas perde completamente a capacidade de generalizar e tomar decisões em novos cenários.

Muitas vezes, a base desse aprendizado complexo (especialmente na criação de bots e NPCs avançados) se dá pelo aprendizado por reforço, onde a IA é treinada baseada em um sistema de recompensas e punições por suas interações com o ambiente virtual.

Hoje, esses dados não estão mais limitados a planilhas. Estamos vivendo o ápice da multimodalidade, a capacidade formidável dos novos modelos de processar diferentes tipos de mídia (texto, imagem, vídeo, áudio) em simultâneo. Para que isso funcione, a IA precisa lidar com a diferença entre dados estruturados vs. não estruturados. Enquanto os dados estruturados são organizados em tabelas claras (como as planilhas de atributos de um RPG), os dados não estruturados são informações livres (como o áudio do voice acting ou fóruns de jogadores).

Ao realizar a Mineração de Dados (Data Mining) nessas vastas fontes, os estúdios conseguem extrair padrões e insights valiosos. Isso possibilita a análise preditiva, que usa padrões históricos para prever eventos futuros (como a taxa de churn, ou abandono, de um MMORPG), e a análise prescritiva, que vai além e sugere ações baseadas em múltiplos cenários possíveis, recomendando eventos in-game para reter a comunidade.

A Arquitetura da Verdade: RAG e as Integrações Complexas

Mas como garantimos que a IA use os dados do nosso estúdio sem alucinar? A resposta arquitetônica que a indústria adotou atende pela sigla RAG (Retrieval-Augmented Generation). Essa é a técnica que permite à IA consultar dados externos e verificados antes de formular uma resposta.

Imagine que você quer um assistente para consultar o roteiro do seu jogo. Primeiro, o sistema pega todos os seus documentos de texto e os transforma em embeddings, que são representações numéricas (vetores matemáticos) que permitem à máquina entender o significado semântico das palavras e conceitos. Esses embeddings são guardados em vector stores, bases de dados especializadas em armazenar e pesquisar essas coordenadas numéricas.

Quando um desenvolvedor faz uma pergunta, o sistema busca na Vector Store os trechos matematicamente mais próximos do sentido da pergunta, e os injeta na IA. Ferramentas modernas, como o Vertex AI Agent Builder do Google, permitem criar esses sistemas de RAG de forma simplificada. A comunicação entre o seu jogo, a Vector Store e o LLM ocorre através de uma API (Application Programming Interface), a ponte invisível de comunicação que permite que softwares distintos conversem entre si.

Automação e a Orquestração do Futuro: De Chatbots a Agentes Autônomos

A verdadeira disrupção que está mudando o ecossistema de trabalho diário nas empresas e nos estúdios indies é a orquestração. Não queremos apenas conversar com a IA; queremos que ela trabalhe por nós. É aqui que entram plataformas visuais de automação, como o n8n e o Google Cloud Workflows (este último, um orquestrador serverless baseado em arquivos YAML para conectar serviços em nuvem).

Nessas plataformas, você constrói um Workflow (o fluxo completo de passos de uma automação). O desenho visual é feito por meio de Nodes (Nós), que são os blocos individuais que executam tarefas específicas, como enviar um e-mail para a equipe de QA ou atualizar um banco de dados. A comunicação de informações entre esses nós geralmente trafega no formato JSON, o padrão universal e leve de estruturação de dados.

Um workflow nunca começa sozinho; ele depende de Triggers (Gatilhos), que são eventos que iniciam o fluxo (como um horário marcado). Muitas vezes, usamos um Webhook, que é uma URL que fica passivamente “escutando” eventos externos — como um commit no GitHub ou uma mensagem no Discord — para disparar uma automação instantaneamente.

Muitos laboratórios universitários e estúdios independentes valorizam imensamente a abordagem self-hosted, que é a capacidade de alojar essas ferramentas de orquestração no seu próprio servidor local ou em containers Docker, garantindo privacidade absoluta dos dados do projeto e redução drástica de custos.

Com essa infraestrutura pronta, transcendemos os chatbots e entramos na era do RPA (Robotic Process Automation) — automações que imitam ações humanas em interfaces, como clicar e copiar — e, principalmente, na era dos Agentes de IA. Agentes são sistemas autônomos que não apenas seguem um script rígido, mas usam a lógica dos LLMs para tomar decisões em tempo real, corrigir os próprios erros e executar tarefas complexas para atingir um objetivo final, como gerenciar testes automatizados de física dentro do seu jogo.

O Fator Humano: Ética, Governança e o Papel da Comunidade Brasileira

Discutir toda essa montanha de tecnologia sem uma profunda reflexão acadêmica e social é um erro que a comunidade de games não pode cometer. Eventos nacionais, como o SBGames, e os diversos simpósios acadêmicos de jogos digitais e tecnologia pelo Brasil, têm debatido ativamente o impacto dessas ferramentas na nossa cultura e no mercado de trabalho.

A implementação da IA exige o uso estrito de Guardrails (Grades de Proteção). São essas regras técnicas, embutidas no código ou no prompt, que mantêm a IA dentro de limites éticos e seguros, impedindo a geração de conteúdo ofensivo ou o vazamento de dados sensíveis. Sem essa curadoria, corremos o risco de amplificar o Bias (Viés) algorítmico, reproduzindo e escalando em velocidade de máquina as distorções e preconceitos causados por dados de treino histórica e socialmente desequilibrados.

A tecnologia precisa ser transparente. É por isso que a área de IA Explicável (XAI) ganha tanta força na pesquisa: não basta que o modelo recuse o crédito de um jogador ou altere a dificuldade do jogo; precisamos de métodos matemáticos que tornem compreensível o porquê dessa decisão ter sido tomada.

Por fim, no coração de qualquer desenvolvimento criativo ou aplicação de políticas públicas para o setor de games, deve estar a filosofia do Human-in-the-loop (HITL). Esse é o modelo operacional em que o ser humano valida, supervisiona ou corrige as ações da IA em pontos críticos do processo. A automação deve servir para libertar os desenvolvedores do trabalho braçal e repetitivo, abrindo espaço para a verdadeira transdisciplinaridade e para o brilho da criatividade humana, que máquina nenhuma consegue replicar.

Aqui reforço o uso da IA deve ser responsável, e se possível não delegue e nem deixe a parte criativa de suas atividades para a IA, dinamize, acelere e ganhe com automação, mas jamais deixe de validar e nem de exercitar sua capacidade de criação, execução e desenvolvimento lógico das suas atividades..

Olhando para o Futuro: As Tendências da IA Generativa em 2026

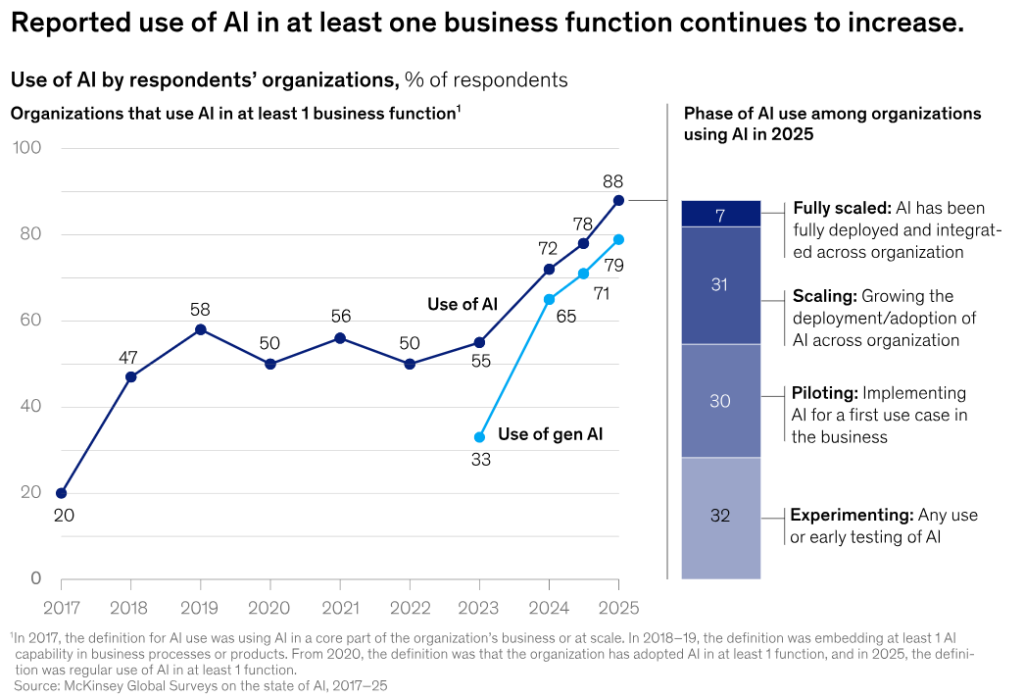

Para amarrarmos todas essas engrenagens técnicas à realidade do mercado atual, vale observarmos a análise “Tendências de IA Generativa para 2026”, publicada recentemente pelo portal de tecnologia ATRA (dezembro de 2025). Como o artigo aponta, estamos atravessando a fronteira de um novo capítulo tecnológico. Podemos ver também o uso cada vez mais consolidado nas empresas, conforme o gráfico a seguir:

Depois de passarmos os últimos anos focados na geração crua de textos, imagens e códigos, a IA madura de 2026 deixa de ser um mero experimento de laboratório (“piloto”) para se tornar o coração de operações complexas. Destacam-se tendências vitais que impactam diretamente a nossa indústria:

- A Era dos Agentes de IA Autônomos: O salto evolutivo definitivo dos chatbots passivos para sistemas inteligentes. Em vez de apenas responderem a prompts, esses agentes tomam decisões em cadeia e resolvem problemas de forma independente, abrindo caminho para Smart NPCs e fluxos de automação de testes de Quality Assurance (QA) quase totalmente autônomos.

- Governança e Qualidade de Dados (“Dados ruins geram decisões ruins”): À medida que conectamos IAs às bases de dados dos nossos estúdios via arquiteturas como o RAG, a qualidade e a estrutura da informação original tornam-se inegociáveis. Se a IA vai atuar sobre as métricas dos jogadores, garantir dados limpos, sem viés e com rastreabilidade é a única forma de evitar o caos.

- Segurança e Integração Operacional: A IA agora divide o palco principal com as tendências de Cibersegurança para 2026, exigindo que os fluxos de trabalho gerados automaticamente respeitem protocolos de proteção contra injeção de prompts maliciosos ou vazamento de código proprietário.

Para nós, pesquisadores e desenvolvedores que estamos debatendo ativamente, o recado dessa transição é cristalino: a fase do deslumbramento ingênuo acabou. Construir jogos e softwares na era dos Agentes de IA exige que encaremos a ética, a governança de dados e o rigor algorítmico com a mesma paixão com que projetamos uma nova mecânica de gameplay.

A automação deve escalar a nossa capacidade de sonhar, e não terceirizar o rigor técnico que nos define.

Considerando a imensa capacidade dos Agentes de IA e os riscos de viés nos dados, de que maneira você acredita que essa tecnologia pode ou não se concretizar nos nosso dias?

E vamos ficando por aqui, espero ter esclarecido muitos dos assuntos e “palavras da moda” para você que chegou até aqui. Até a próxima!

A inteligência pode até ser artificial, mas as ideias que colocamos em jogo — e as consequências delas — são profundamente reais.

Referências:

- Artigo: “Attention Is All You Need” [Tradução]}

https://medium.com/@msmurilo/tradu%C3%A7%C3%A3o-artigo-attention-is-all-you-need-2f7a4113b3be - Artigo: “Attention Is All You Need”

https://arxiv.org/abs/1706.03762 - The state of AI in 2025: Agents, innovation, and transformation https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai

- Tendências de IA Generativa para 2026

https://www.atra.com.br/2025/12/10/tendencias-de-ia-generativa-para-2026/ - História da IA: de Alan Turing aos dias atuais

https://hub.asimov.academy/blog/historia-da-inteligencia-artificial/ - A Brief History of Generative AI

https://www.dataversity.net/articles/a-brief-history-of-generative-ai/

Professor, Analista de Sistemas, Presidente da UCEG e pai do Icaro.

“Os jogos podem mudar o mundo”